March 31, 2026

AI Content Moderation for Social Media Walls: A Complete Guide

X Minute gelesen

Soziale Infrastruktur, die mit Ihnen skaliert.

Starten Sie Ihre kostenlose Testversion oder lassen Sie sich von uns die Plattform in Aktion zeigen.

Every brand that aggregates social media content on its website faces the same question: what happens when the wrong post slips through?

A single piece of spam, an offensive caption, or an off-brand image on your social wall can undo months of careful brand building. AI content moderation for social media lets you catch those posts automatically, before your audience ever sees them.

But is it even necessary?

The content moderation services market was valued at $12.48 billion in 2025 and is projected to reach $42.36 billion by 2035. This signals the importance of moderation in how businesses manage public-facing content.

In this quick guide, we will explore how social media AI content moderation works for aggregated feeds, where manual review falls short, and how Flockler's Garde AI handles it in practice.

Why Content Moderation Matters When You Aggregate Social Feeds

Embedding live social media content on your website builds trust, adds social proof, and keeps pages fresh. Brands like Dover Saddlery, Kylie Cosmetics, and GoPro use aggregated feeds to showcase real community content across their digital platforms.

The challenge is that you are pulling content you did not create. When you aggregate posts from a branded hashtag or public mentions, anyone can contribute. That opens the door to:

- Spam and promotional content from bots or competitors

- Offensive language, hate speech, or profanity

- Explicit or violent imagery

- Misleading claims about your products

- Off-topic posts that dilute your feed quality

What Happens Without Moderation

McDonald's experienced this during their #McDStories campaign. The brand wanted customers to share positive stories. Instead, people used the hashtag to post negative experiences. Without moderation, those posts would have appeared on any social wall or website pulling that hashtag feed.

Meta's AI systems now proactively detect and remove roughly 95% of violating content before any user reports it. Your website does not have that infrastructure. When a post from a public hashtag feed lands on your social wall, you need your own filtering layer to catch what the source platform missed.

When Manual Review Breaks Down

Manual moderation works for small volumes. A team member reviews each post, approves those that fit, and hides the rest. This approach breaks down when:

- You are running a live event with hundreds of posts per hour

- You manage multiple feeds across different social platforms

- You aggregate high-volume hashtag campaigns

- Your team does not have bandwidth for round-the-clock review

Social media AI content moderation handles the volume, speed, and consistency that manual review cannot match.

How AI Content Moderation Works for Social Walls

AI content moderation uses machine learning models to analyze incoming content against a set of rules and patterns. For social media aggregation, it handles three core tasks:

Text Screening

Natural language processing (NLP) models scan captions, comments, and hashtags for profanity, hate speech, spam, and misleading claims. Modern NLP goes beyond simple keyword matching. It analyzes context and sentence structure, so a post saying "I hate this bug in my code" is not treated the same as targeted hate speech.

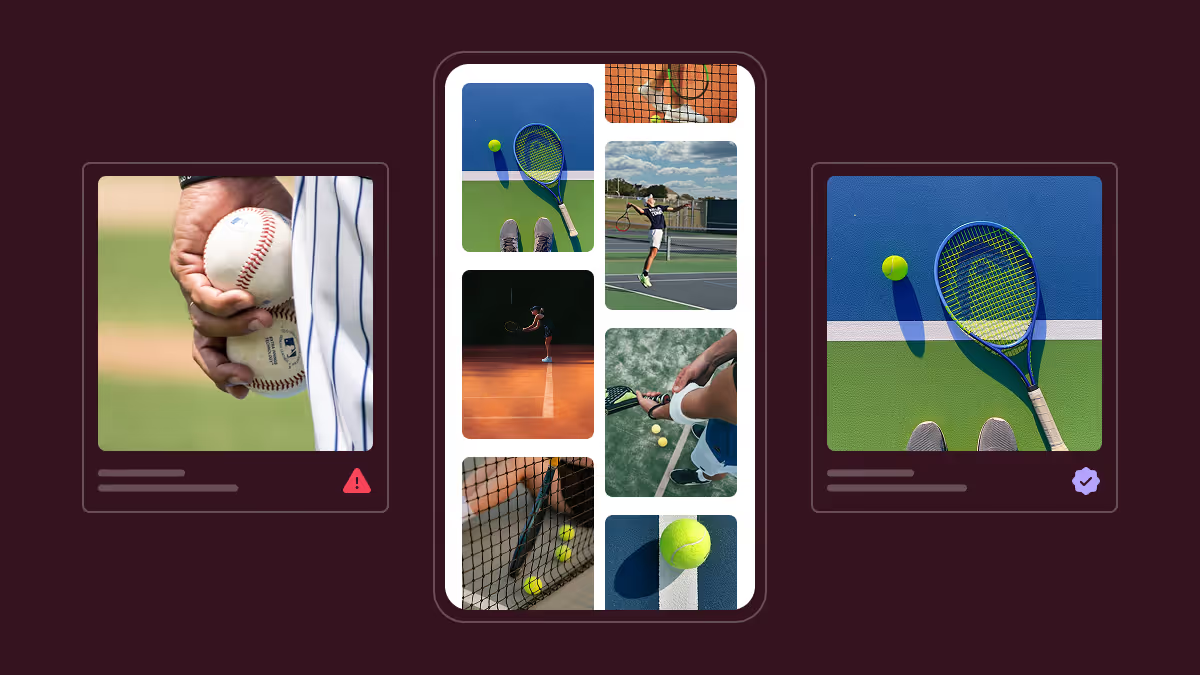

Image Analysis

Computer vision models scan photos and graphics for explicit material, violence, or content that does not fit brand guidelines. This is critical for hashtag campaigns where anyone can contribute visual content, and you have no control over it.

Relevance Filtering

AI identifies posts that are off-topic, promotional spam from competitors, or low-quality content that would weaken your feed. This keeps your social wall focused and useful for visitors, rather than cluttered with irrelevant posts.

The result is a cleaner feed that reaches your website faster, with fewer gaps from delayed manual reviews and fewer risks from content that should never have appeared alongside your brand.

Manual vs. AI Content Moderation: Which One Do You Need?

Human moderators understand sarcasm, cultural references, and brand nuance in ways that AI cannot always replicate. If a post uses irony or a niche community joke, a human reviewer will make the right call more often than an algorithm.

The challenge is scale. Meta reported in early 2025 that its AI systems reviewed approximately 10 billion pieces of content per quarter for policy violations. No human team can operate at that speed.

Here is where each approach works best:

AI moderation excels at:

- Catching explicit images, profanity, and spam links at speed

- Processing high volumes of posts without fatigue or inconsistency

- Screening content 24/7 without staffing costs

- Filtering across multiple languages simultaneously

Human review is better for:

- Borderline cases where tone or intent is ambiguous

- Content that requires cultural or regional context

- Sarcasm, satire, and humor that AI may misinterpret

- Final approval of flagged posts before publication

The most effective approach combines both. Let AI handle the high-volume filtering as posts arrive. Then let your team review flagged posts that need human judgment. This layered model reduces workload while maintaining high decision quality where it matters most.

5 Features to Look for in a Moderation Tool for Aggregated Feeds

If you are evaluating social media AI content moderation options, focus on the following five criteria:

- Integration with your aggregation workflow. Moderation should happen inside the same platform where you collect and display content. Separate tools add complexity and gaps.

- Content type support. Check whether the tool moderates text, images, video, or all three. Text and image coverage handle the majority of UGC in aggregated feeds.

- Human override capability. Your tool should let you review and override AI decisions from a dashboard or inbox.

- Transparency and reporting. You need to see what the AI is filtering and why. Reports help you tune your approach over time.

- Scalability. The tool should handle volume spikes during campaigns, events, and product launches without delays.

If your team is building more advanced automation around content operations, working with an AI agent development company can also help connect moderation workflows with the rest of your marketing stack without adding unnecessary complexity.

How Garde AI Works Inside Flockler

Flockler is a social media aggregation platform that collects, moderates, and displays content from 13+ social channels on websites, apps, digital screens, and intranets.

Garde AI is Flockler's built-in AI content moderation tool, designed for the moderation challenges that come with aggregated feeds.

Setting Up AI Moderation in 3 Steps

When you create an automated feed in Flockler, you pick a content source (an Instagram hashtag, TikTok account or LinkedIn page) and choose your moderation mode.

- Step 1: Set up your content feed. Choose your sources and configure the hashtag or brand feed you want to moderate.

- Step 2: Activate Garde AI. Toggle on "Moderate with Garde AI" in your dashboard. This filters all incoming content through the AI before anything goes live.

- Step 3: Review and approve. Once Garde AI has filtered the content, review flagged posts and approve or reject them manually from your content tab.

What Garde AI Filters

Garde AI scans both text and images in each incoming post. It filters out:

- Offensive language and profanity

- Explicit or violent imagery

- Hate speech and discriminatory content

- Sensitive personal data

- Misleading claims

- Spam and promotional content

- Off-brand or irrelevant posts

This covers the types of content that pose the biggest risk when you aggregate public social posts for your website or event screens.

Current Limitations of AI Content Moderation

Garde AI currently supports text and image moderation. If your feed includes video posts, the AI will analyze the accompanying text but will not review the video content itself. For feeds with heavy video content, combining Garde AI with manual review provides more complete coverage.

Reviewing What AI Catches

Garde AI does not work as a black box. When content is flagged and hidden, you can see exactly what was filtered from your Flockler content tab. You can:

- Manually approve and publish any post that the AI hid

- Review moderation reports showing all filtered content

- Spot patterns in flagged content to refine your blocklists

- Override AI decisions when a post is appropriate for your brand

This human-in-the-loop approach means AI handles volume while you keep final control over what appears on your social walls.

Plan Availability and Limits

Garde AI is available on Flockler's Business ($195/month), Pro ($325/month), and Premium (custom pricing) plans. Each plan includes 300 AI-moderated posts per month. Once you reach the limit, manual moderation remains available.

Flockler offers a 14-day free trial with no credit card required. You can test the platform using the free trial. However, Garde AI is available upon upgrading to a Business, Pro, or Premium plan.

How to Build a Layered Content Moderation Workflow

AI moderation works best as part of a layered approach. Here are the four components of Flockler’s Garde AI that give brands the most control.

Layer 1: Keyword and Username Blocklists

Flockler lets you block specific keywords and usernames from your feeds. This catches known spam terms, competitor brand names, or phrases that conflict with your campaigns. Use this as your first filter.

Layer 2: AI Filtering With Garde AI

Garde AI scans every post for harmful, explicit, or irrelevant material. It catches content that keyword lists miss, especially visual content and context-dependent language.

Layer 3: Manual Review for Edge Cases

Posts that AI flags can be moved to an inbox for human review. Your team makes the final call on borderline content. This is where brand nuance and cultural context come in.

Layer 4: Regular Moderation Reports

Review what Garde AI filters to spot patterns. If you see recurring spam from a specific account or keyword, add it to your blocklist. If the AI is hiding posts that should be approved, adjust your review process.

Each component handles what it does best. Keywords catch known problems. AI catches visual and contextual issues at scale. Humans handle the gray areas.

For teams with sizable social feeds, this layered approach can save 6 to 10 hours of manual moderation work per week. That time can go back to your editors and content managers for strategic tasks.

Practical Use Cases for AI Content Moderation

Here are the scenarios where it makes the biggest difference for brands using aggregated feeds.

Hashtag Campaigns

You encourage customers to post with your branded hashtag, then aggregate those posts on your website. The risk is that anyone can use your hashtag. Spammers, competitors, or trolls all contribute to the same feed. AI content moderation for social media filters out the noise before it reaches your audience.

Live Events

Event social walls display real-time posts from attendees. Content volume spikes during keynotes and performances. Manual review cannot keep pace. Garde AI screens posts as they arrive, keeping the display clean without delays. This is especially valuable for conferences, sports events, and award ceremonies.

E-commerce Product Pages

Brands that embed customer photos and reviews on product pages need those feeds to stay relevant. A single explicit or irrelevant post, even when paired with product descriptions, can erode buyer confidence. AI moderation ensures every visible post supports the shopping experience.

Multi-language Feeds

If your brand operates across multiple markets, your aggregated feeds may include content in several languages. AI moderation scans across languages, catching violations that a single-language human reviewer would miss. This is useful for global brands and universities with international communities.

The Regulatory Side of Content Moderation

Content moderation is not only a brand safety issue. It is also becoming a compliance requirement.

Laws like the EU's Digital Services Act are pushing platforms toward greater accountability and transparency in their moderation processes. Under the DSA, serious or repeated breaches can result in fines of up to 6% of a company's global annual turnover.

These regulations primarily target large social media platforms, but they also set expectations for any brand that publicly displays user-generated content. If your website showcases aggregated social posts, you are responsible for what appears there. AI content moderation gives you a documented, consistent process for screening content before it goes live.

Making AI Content Moderation Work for Your Brand

When you pull posts from hashtags, mentions, and public accounts, keeping the feed clean takes real effort. Reviewing every post manually eats into your week, and things still slip through.

Garde AI takes that job off your plate. It screens incoming posts in Flockler, filters out anything harmful or off-brand, and lets you review what it catches. Teams with busy feeds typically save 6 to 10 hours a week on moderation alone.

You can try it out with a 14-day free trial at flockler.com.

FAQs

How Does Garde AI Work in Flockler?

Garde AI is Flockler's built-in moderation tool. When you create an automated feed, you select Garde AI as your moderation mode. It then scans every incoming post for offensive language, explicit imagery, spam, and irrelevant content. Posts that pass the filter are published automatically. Flagged posts are hidden, and you can review them manually from your Flockler dashboard.

Which Flockler Plans Include Garde AI?

Garde AI is available on Flockler's Business ($229/month), Pro ($379/month), and Premium (custom pricing) plans. Each plan includes 300 AI-moderated posts per month. Once you reach the limit, manual moderation remains available. You can also test Garde AI during Flockler's 14-day free trial with a limited number of moderation credits.

Can AI Content Moderation Replace Human Moderators?

AI handles high-volume, clear-cut violations effectively. It excels at catching explicit images, profanity, and spam. However, it can miss context, sarcasm, and cultural nuances. The best approach combines AI filtering for speed and scale with human review for edge cases. Flockler supports this by letting you review and override any AI decision.

Does Garde AI Moderate Video Content?

Garde AI currently moderates text and images. If your feed includes video posts, the AI will analyze the accompanying text but will not review the video content itself. For feeds with heavy video content, combining Garde AI with manual review provides fuller coverage.

Maria Prakkat is a SaaS content marketing and SEO strategist with experience across SEO, GEO, and social media aggregation. She writes in-depth, research-backed content that helps businesses understand and apply solutions like social media aggregators, UGC platforms, and content distribution tools to improve visibility and engagement. Her work focuses on clarity, relevance, and long-term impact.

Soziale Infrastruktur, die mit Ihnen skaliert.

Starten Sie Ihre kostenlose Testversion oder lassen Sie sich von uns die Plattform in Aktion zeigen.